📖 1. 다중 분류 모델 기본 구조

🔹 구조 흐름

입력층 (Input Layer)

↓

가중치 연산 (W · x + b)

↓

활성화 함수: Softmax

↓

출력층 (Output Layer) → 클래스별 확률| 입력층 | 특징(Feature) 벡터 입력 |

| 가중치 W, 편향 b | 학습 가능한 파라미터 |

| Softmax 함수 | 출력값을 클래스별 확률로 변환 |

| 출력층 | 예측 확률이 가장 높은 클래스를 선택 |

예: 숫자 인식 문제에서는 0~9 총 10개의 클래스 → 출력층은 노드 10개

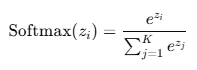

📊 2. Softmax 함수란?

🔹 정의:

Softmax는 다중 클래스 분류에서 사용되는 활성화 함수로, 모델 출력값을 확률값으로 정규화시켜줌.

| ziz_i | 각 클래스에 대한 로짓(logit, 선형 출력값) |

| KK | 총 클래스 개수 |

| 결과 | 모든 클래스 확률의 총합은 1이 되며, 가장 큰 확률값을 예측값으로 사용 |

📌 예:

- 모델 출력값: [2.1, 0.5, 4.0]

- Softmax 결과: [0.12, 0.02, 0.86] → 클래스 2가 예측 결과

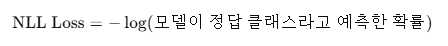

🔥 3. 손실 함수: Negative Log-Likelihood (NLL)

🔹 개념:

- 다중 클래스 분류에서 Softmax 출력과 정답 간 차이를 측정

- 예측 확률이 정답 클래스에 가까울수록 손실이 작아짐

| 정확히 예측 (확률 0.95) | -log(0.95) ≈ 0.05 (작음) |

| 틀림 (확률 0.1) | -log(0.1) ≈ 2.3 (큼) |

PyTorch나 TensorFlow에서는 CrossEntropyLoss()가 Softmax + NLL을 함께 처리해줌

📌 요약 정리

항목설명

| 모델 구조 | 입력 → 가중치 연산 → Softmax → 클래스 확률 |

| Softmax 함수 | 출력값을 정규화하여 각 클래스의 확률로 변환 |

| 예측 결과 | 가장 확률이 높은 클래스가 최종 결과 |

| NLL 손실 함수 | 정답 클래스에 대해 모델이 얼마나 확신했는지를 평가 |

'인공지능' 카테고리의 다른 글

| AlexNet (0) | 2025.03.21 |

|---|---|

| CNN (0) | 2025.03.21 |

| 이진 분류(Binary Classification) 모델 정리 (0) | 2025.03.21 |

| 선형 회귀 (Linear Regression) (0) | 2025.03.21 |

| 예측 함수, 손실 함수, 비용 함수, 분류 및 활성화 함수 정리 (0) | 2025.03.20 |