📖 1. 선형 회귀란?

- **지도 학습(Supervised Learning)**의 한 종류

- 예측하고자 하는 **목표값(종속 변수, y)**이 연속적인 수치형 값일 때 사용

- 데이터를 직선 혹은 곡선 형태로 모델링하여 예측

📚 2. 종류에 따른 구분

종류설명예시

| 단순 선형 회귀 (Simple Linear Regression) | 입력변수가 하나인 경우 | 집 평수(x) → 가격(y) |

| 다중 선형 회귀 (Multiple Linear Regression) | 입력변수가 여러 개인 경우 | 평수, 위치, 연식 등 여러 요인 → 가격 |

| 다항 회귀 (Polynomial Regression) | 입력변수의 차수를 올려 곡선으로 모델링 | 공부시간(x)에 따른 성적(y)의 곡선 관계 |

🧮 3. 선형 회귀 모델 수식

💡 기본 형태:

기호의미

| yy | 실제 목표값(종속 변수) |

| xx | 입력값(독립 변수) |

| β0\beta_0 | 절편(intercept): x=0일 때의 y값 |

| β1\beta_1 | 기울기(slope): x가 변할 때 y가 얼마나 변하는지 |

| ε\varepsilon | 오차항(error term): 실제값과 예측값의 차이 |

🔍 4. 최소제곱법 (OLS: Ordinary Least Squares)

💡 핵심 개념:

- **예측값과 실제값의 차이(오차)**를 제곱한 값들의 합을 최소화하여 가장 적절한 회귀선을 찾음

⚙️ 구현 방법:

- 해석적 방법: 수식을 통해 직접 계산 (행렬 연산)

- 경사 하강법(Gradient Descent): 반복적으로 가중치를 조정하여 오차 최소화

🎯 목적:

🔁 5. 다항 회귀 (Polynomial Regression)

💡 왜 필요할까?

- 단순 선형 회귀는 직선 형태의 데이터만 설명 가능

- 현실 데이터는 곡선일 수 있으므로, 더 높은 차수의 항을 추가하여 모델링

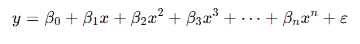

📐 수식 예시:

- x2,x3x^2, x^3 등의 항을 통해 곡선 형태의 데이터도 모델링 가능

- 과도한 차수 사용 시 **과적합(overfitting)**에 주의해야 함

📌 정리 요약

구분설명

| 선형 회귀 | 입력값과 출력값 사이의 관계를 직선으로 모델링 |

| 최소제곱법(OLS) | 예측 오차의 제곱합을 최소화하여 최적의 직선 도출 |

| 다항 회귀 | 곡선 형태의 데이터를 설명하기 위해 입력값의 차수를 올린 회귀 |

| 학습 방법 | 해석적 방법(행렬 연산), 경사하강법 등 |

'인공지능' 카테고리의 다른 글

| 다중 분류 (Multi-class Classification) (0) | 2025.03.21 |

|---|---|

| 이진 분류(Binary Classification) 모델 정리 (0) | 2025.03.21 |

| 예측 함수, 손실 함수, 비용 함수, 분류 및 활성화 함수 정리 (0) | 2025.03.20 |

| 합성 함수, 수치 미분, 경사 하강법 정리 (0) | 2025.03.20 |

| AI, 머신러닝, 딥러닝 개요 및 핵심 개념 정리 (1) | 2025.03.20 |