1️⃣ 예측 함수 (Object Function)

📌 예측 함수란?

- 신경망의 입력층(Input Layer) → 은닉층(Hidden Layer) → 출력층(Output Layer) 을 거쳐 예측값을 생성하는 함수.

- 입력값(xx), 가중치(Weight), 바이어스(Bias) 를 조합하여 출력(yy)을 계산.

- 신경망을 통해 패턴을 학습하고, 입력 데이터를 바탕으로 예측 수행.

2️⃣ 손실 함수 (Loss Function) vs 비용 함수 (Cost Function)

항목정의역할

| 손실 함수 (Loss Function) | 개별 데이터 샘플에 대한 오차(Error)를 측정하는 함수 | 특정 데이터 예제에 대한 모델 성능 평가 |

| 비용 함수 (Cost Function) | 학습 데이터 전체에서 손실 함수의 평균 또는 합계를 계산하는 함수 | 모델 전체의 성능을 평가하는 지표 |

✔ 비용 함수는 손실 함수의 전체 평균 또는 합으로 계산됨.

✔ 최적화 알고리즘(예: 경사 하강법)은 비용 함수를 최소화하는 방향으로 학습 진행.

3️⃣ 비용 함수의 종류

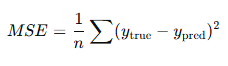

📌 회귀 예측 (Regression)

- 목표값이 연속형 데이터인 경우 사용.

- MSE (Mean Squared Error, 평균 제곱 오차) 사용.

✔ 예제:

- 집값 예측

- 혈압/호르몬 농도 예측

- 공장의 생산 수율 예측

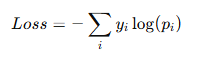

📌 이진 분류 (Binary Classification)

- 목표값이 두 개의 클래스로 구분되는 경우 사용.

- Binary Crossentropy 사용.

✔ 예제:

- 시험 결과: Pass / Fail

- 신용 등급: 양호 / 불량

- 종양 판별: 악성 / 양성

- 이메일 분류: 스팸 / 정상

🔹 활성화 함수: Sigmoid 함수 사용

→ 출력값을 (0,1) 사이의 확률값으로 변환하여 확률 기반 예측 가능.

📌 다중 분류 (Multinomial Classification)

- 목표값이 3개 이상의 클래스로 구분되는 경우 사용.

- Crossentropy (Categorical Crossentropy) 사용.

✔ 예제:

- 성적 등급: 상 / 중 / 하

- 신용 등급: 매우 양호 / 양호 / 보통 / 불량 / 매우 불량

- 붓꽃의 종류: Setosa / Versicolor / Virginica

🔹 활성화 함수: Softmax 함수 사용

→ 각 클래스의 확률을 계산하고 총합이 1이 되도록 정규화.

4️⃣ 활성화 함수 (Activation Function)

활성화 함수설명사용처

| Sigmoid | 출력값을 (0,1) 사이의 확률값으로 변환 | 이진 분류(Binary Classification) |

| Softmax | 다중 클래스의 확률을 계산하고 총합을 1로 정규화 | 다중 분류(Multinomial Classification) |

✔ Sigmoid는 확률 값(0~1)로 변환하여 이진 분류에 적합.

✔ Softmax는 여러 개의 클래스 확률을 구할 때 사용.

📌 최종 요약

✔ 예측 함수(Object Function) → 입력 데이터를 신경망을 통해 학습하고 예측값을 생성하는 함수.

✔ 손실 함수(Loss Function) → 개별 샘플의 오차(Error)를 측정하는 함수.

✔ 비용 함수(Cost Function) → 전체 데이터셋의 손실을 평균 또는 합산하여 모델 성능을 평가하는 함수.

✔ 비용 함수의 종류:

- 회귀(Regression) → MSE 사용 (연속형 데이터)

- 이진 분류(Binary Classification) → Binary Crossentropy 사용

- 다중 분류(Multinomial Classification) → Categorical Crossentropy 사용

✔ 활성화 함수 - Sigmoid → 이진 분류에서 사용

- Softmax → 다중 분류에서 사용

🎯 신경망 학습의 핵심 목표는 손실을 최소화하여 예측 성능을 높이는 것🚀

'인공지능' 카테고리의 다른 글

| 이진 분류(Binary Classification) 모델 정리 (0) | 2025.03.21 |

|---|---|

| 선형 회귀 (Linear Regression) (0) | 2025.03.21 |

| 합성 함수, 수치 미분, 경사 하강법 정리 (0) | 2025.03.20 |

| AI, 머신러닝, 딥러닝 개요 및 핵심 개념 정리 (1) | 2025.03.20 |

| 파이토치 (0) | 2025.03.20 |